Si les outils standardisés peuvent appréhender les résultats observables, ils passent souvent à côté des facteurs internes telles que la motivation, la perception et l'hésitation qui déterminent la prise de décision réelle en développement. Dans le cadre d'un travail avec des petits exploitants agricoles en Chine, les réponses à une enquête on fournit peu d'informations sur ces processus, soulignant la nécessité d'adopter des approches comportementales qui révèlent les dimensions sous-évaluées du changement.

Si les outils standardisés peuvent appréhender les résultats observables, ils passent souvent à côté des facteurs internes telles que la motivation, la perception et l'hésitation qui déterminent la prise de décision réelle en développement. Dans le cadre d'un travail avec des petits exploitants agricoles en Chine, les réponses à une enquête on fournit peu d'informations sur ces processus, soulignant la nécessité d'adopter des approches comportementales qui révèlent les dimensions sous-évaluées du changement.

Les outils comportementaux en évaluation ne sont plus marginaux mais d'usage courant

Ce décalage est de plus en plus reconnu dans le secteur. La note d'orientation sur les sciences comportementales (Guidance Note on Behavioral Science) du Secrétaire général des Nations Unies exhorte les organisations à «examiner et appliquer les sciences comportementales dans les domaines programmatique et administratif», et la semaine des Nations Unies sur les sciences comportementales de 2025 (2025 UN Behavioral Science Week) a montré le travail mené dans 46 organisation des Nations Unies, couvrant le climat, l'inclusion digitale et la protection sociale. Ces outils ne sont plus des outils de niche mais deviennent institutionnels.

L'Unité eMBeD (Mind, Behavior, and Development) de la Banque mondiale a intégré les données comportementales dans ses évaluations dans plus de 70 pays, permettant à ses équipes d'aller au-delà des indicateurs superficiels pour comprendre la manière dont les personnes prennent leur décision dans des conditions réelles. Simultanément, l'initiative de la FAO d'auto-appréciation et d'évaluation holistique de la résilience climatique des agriculteurs et éleveurs (Self-Evaluation and Holistic Assessment of Climate Resilience of Farmers and Pastoralists SHARP+ ) a adapté les enquêtes auprès des ménages en intégrant des questions comportementales afin de comprendre pourquoi les agriculteurs ont adopté ou résisté à certaines pratiques agricoles. Sans s'arrêter au taux d'adoption, l'évaluation a analysé les perceptions, les compromis et les modèles mentaux qui orientent les choix réels. Ces modifications reflètent une meilleure reconnaissance: nous ne pouvons pas comprendre l'impact si nous ne comprenons pas le comportement.

Lorsque les outils standard ne suffisent pas

Malgré cet élan, les outils d'évaluation comportementaux traditionnels, en particulier les enquêtes standardisées, échouent souvent à comprendre comment les personnes pensent et se comportent. Cela ne tient pas seulement à la mauvaise formulation des questions, mais cela reflète un décalage structurel entre la rigidité des instruments et la complexité du monde réel.

De nombreuses questions comportementales ou attitudinales utilisées dans les évaluations trouvent leur origine dans les populations occidentales, instruites, industrialisées, riches et démocratiques (Western, Educated, Industrialized, Rich, and Democratic ou WEIRD), en postulant que les répondants connaissent les concepts abstraits, la logique individualiste et les cadres de prise de décision formelle. Toutefois, ces hypothèses ne tiennent pas dans les contextes dans lesquels la plupart des programmes de développement sont mis en œuvre. Dans les contextes ruraux par exemple, des concepts tels que l'«autonomie individuelle» ou la «préférence en matière de risque» peuvent ne pas avoir de sens dans la vie quotidienne ou dans la langue locale. Les répondants peuvent avoir du mal à interpréter les questions abstraites d'une enquête ou des formats utilisant l'échelle de Likert, non pas à cause d'une insuffisance de capacités, mais en raison d'un cadre culturellement éloigné et cognitivement étranger. Ce décalage de compréhension est aggravé par le biais de désirabilité social (social desirability bias). Dans les communautés très soudées au sein desquelles le statut, la préservation de l'image et le respect d'une autorité comptent beaucoup, les personnes ont tendance à adapter leurs réponses pour se conformer à ce qu'ils pensent qu'on attend d'eux. Par conséquent, les réponses ont tendance à refléter les normes sociales plutôt que les opinions ou les intentions réelles – ce qui masque précisément les comportements que les évaluations visent à comprendre.

Mesure comportementale repensée comme un jeu

Dans mon propre travail, ces limites n'étaient pas théoriques – il s'agissait de réalités de terrain. Nous avons entrepris de mesurer les préférences en termes de risques parmi les petits exploitants agricoles au Shanxi et les éleveurs nomades en Mongolie intérieure. La préférence en termes de risque est un facteur essentiel dans le domaine du développement rural: elle influence les agriculteurs pour l'adoption de nouvelles technologies, l'investissement en intrants, la diversification de leur revenu ou leur adhésion à des systèmes d'assurance et de crédit formels. Les enquêtes utilisant l'échelle de Likert, se sont montrées inappropriées. Les répondants ont eu du mal avec le langage abstrait et leurs réponses sont souvent apparues prudentes ou incohérentes, souvent générées par une incompréhension ou des attentes sociales.

C'est pourquoi j'ai créé un outil différent: un jeu comportemental basé sur WeChat qui utilise le BART (Balloon Analogue Risk Task), test bien établi qui mesure la prise de risque à travers le jeu. C'est un test simple: les joueurs gonflent un ballon virtuel pour gagner des récompenses, en risquant de le faire éclater à chaque gonflage. Il ne pose pas de questions sur le risque mais révèle celui-ci à travers le comportement dans l'incertitude. Intégré dans un mini-programme WeChat, cet outil était accessible sur un téléphone connecté à internet sans nécessiter de téléchargement ou de connaissances techniques. Un concepteur d'expérience utilisateur a contribué à simplifier l'interface pour les utilisateurs plus âgés ou peu instruits (figure 1). Un développeur s'est chargé de la collecte des données de backend et du suivi en temps réel. Les enquêteurs pouvaient familiariser les répondants au jeu en quelques minutes (figure 2).

Figure 1. Ressources visuelles du jeu mobile BART utilisé dans l'évaluation.

Ces modules sous formes de ballons colorés offrent des informations visuelles sur le comportement de prise de risque des participants.

Figure 2. Interface de jeu: les joueurs appuient sur le bouton vert pour gonfler le ballon ou pour le convertir en gains.

Pourquoi les tâches comportementales marchent mieux que les enquêtes

- Pas de raisonnement abstrait: Les participants ne font rien d'autre que jouer.

- Biais de réponse réduit: aucun besoin de rendre compte ou de justifier ses choix.

- Barrières abaissées: App. familière, design intuitif.

- Données comportementales directes: décisions observées dans des conditions réelles.

Les répondants ont trouvé le jeu prenant et ont même demandé à jouer encore (figure 3). Plus qu'un outil de données, le jeu a ouvert la voie au dialogue, en rendant l'évaluation moins extractive et plus collaborative. Les données ont montré comment les outils comportementaux, lorsqu'ils sont conçus conjointement et intégrés localement, peuvent transformer l'expérience même de l'évaluation.

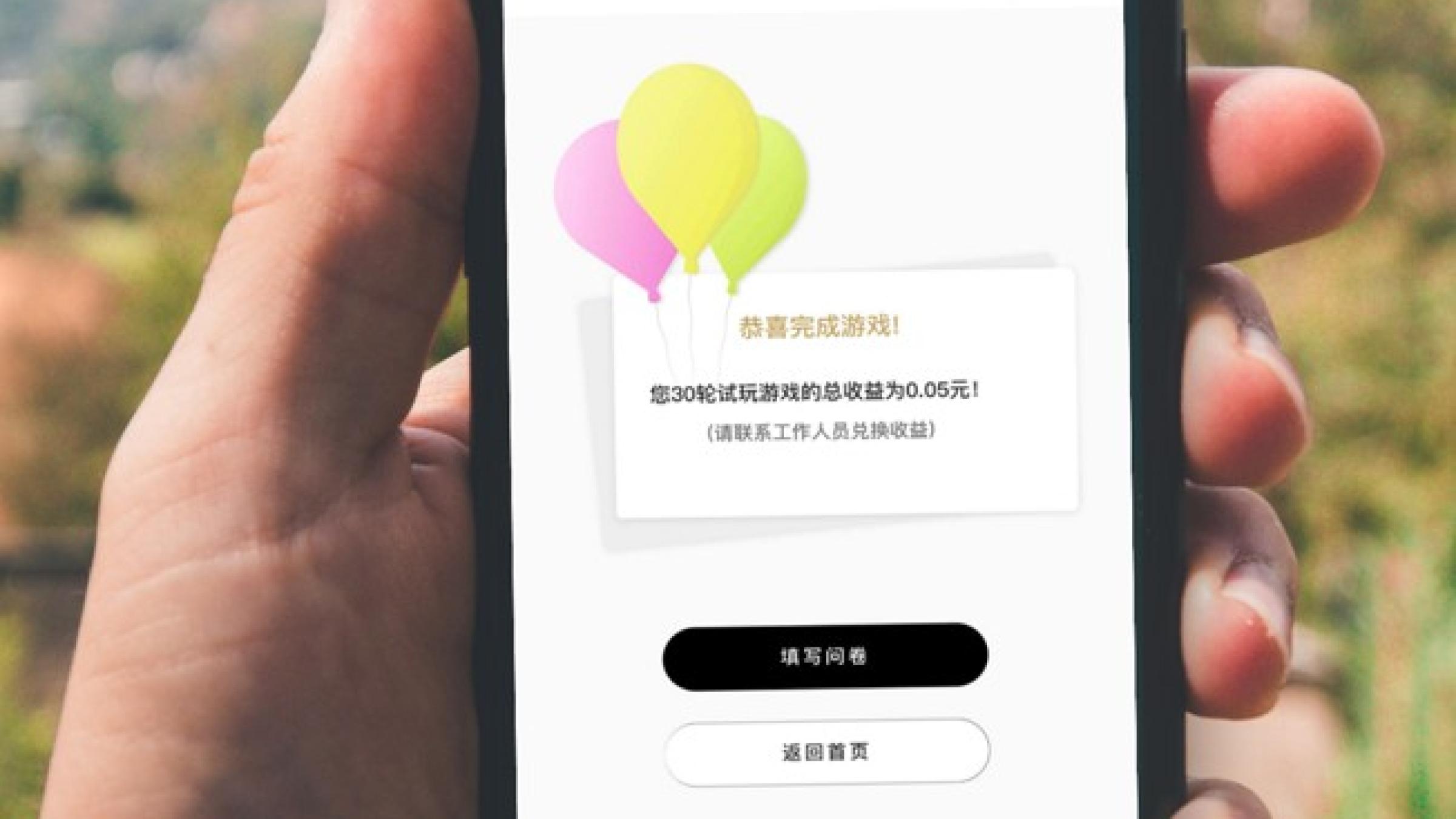

Figure 3. Résultats du jeu affichés sur le téléphone d'un répondant, montrant le gain final de la tâche.

L'IA comme facilitateur d'instruments rapides à faible coût

Ceci a été rendu possible pas uniquement grâce à une nouvelle approche mais grâce à une nouvelle technologie accessible. Si autrefois la création de tels outils nécessitait une équipe technique complète, l'IA permet maintenant de créer plus facilement des prototypes de mesures comportementales avec des compétences minimales en matière de programmation. Un exemple clé est le vibe coding[1], flux de travail où les utilisateurs décrivent ce qu'ils veulent en langue naturelle et où l'IA permet de générer le code sous-jacent. Un évaluateur peut par exemple demander: «crée une tâche dans laquelle les utilisateurs répartissent des jetons entre un compte personnel et un compte commun pour mesurer la prise de décision coopérative.» L'IA est à même de fournir en retour un script Python fonctionnel, que l'évaluateur peut ensuite tester, adapter et affiner.

Des plateformes telles que Hugging Face (avec par exemple des outils tels que Gradio ou Streamlit) peuvent transformer un tel code en applications interactives sur internet, alors que Figma permet aux non-programmeurs d'obtenir une maquette d'interface utilisateur pour les tâches et les évaluations. Ces outils permettent de passer rapidement d'un concept à un prototype et à faible coût, même en l'absence d'une équipe spécifique de programmation ou de conception. Si une certaine compréhension est encore nécessaire, certaines tâches qui requéraient autrefois de multiples experts peuvent maintenant être gérées par une personne ayant des compétences de niveau débutant, ce qui réduit les délais, les coûts et la complexité.

Repenser le comportement, réécrire l'évaluation

Si nous voulons comprendre le comportement en développement, nous avons besoin d'instruments qui le reflètent. Des enquêtes standardisées basées sur des hypothèses ne nous permettront pas d'y arriver. Pour que l'évaluation soit plus inclusive, crédible et tournée vers l'avenir, nous avons besoin de méthodes qui se basent sur la manière dont les personnes prennent réellement leurs décisions dans le domaine du développement.

D'un jeu mobile dans la Chine rurale à des diagnostics comportementaux menés au sein des Nations Unies et de la Banque mondiale, il est clair que l'évaluation évolue. La prochaine étape consiste à élargir de manière créative notre boîte à outils: en examinant les mesures comportementales dans des conditions de terrain, en utilisant l'IA afin de faciliter la conception d'instruments et en ouvrant la voie à la co-création avec les communautés que nous visons à comprendre.

[1] Le Vibe coding (ou «codage au ressenti») est une nouvelle expression relative à l'utilisation de l'intelligence artificielle pour traduire des instructions fournies en langage naturel en code fonctionnel, permettant ainsi à des personnes non expertes de générer et d'adapter des scripts à travers des plateformes telles que OpenAI (ChatGPT + interprète de code), Hugging Face Spaces ou Streamlit apps.