En las dos últimas décadas, el ámbito de la evaluación ha reforzado notablemente su calidad técnica. Los estándares metodológicos han mejorado, los enfoques de métodos mixtos se utilizan ahora de forma generalizada y los requisitos en materia de rigor y transparencia han aumentado.

En las dos últimas décadas, el ámbito de la evaluación ha reforzado notablemente su calidad técnica. Los estándares metodológicos han mejorado, los enfoques de métodos mixtos se utilizan ahora de forma generalizada y los requisitos en materia de rigor y transparencia han aumentado.

Sin embargo, las evaluaciones siguen enfrentándose a un desafío: su influencia en la toma de decisiones continúa siendo limitada, incluso cuando son técnicamente sólidas y se basan en métodos rigurosos y análisis minuciosos.

En programas de desarrollo, humanitarios y medioambientales se generan informes de evaluación, que se reconocen formalmente y en ocasiones se elogian. No obstante, sus conclusiones no suelen influir en las decisiones estratégicas, la asignación de recursos o la revisión de programas. Tal y como señala Munyayi (2025), esto refleja un problema más amplio: los informes de evaluación satisfacen requisitos de rendición de cuentas, pero tienen poca influencia en decisiones posteriores.

Esta carencia plantea una pregunta más profunda: ¿por qué las evaluaciones técnicamente sólidas no logran orientar decisiones que se supone deben fundamentar?

Basándose en la experiencia adquirida en evaluaciones, seguimiento y sistemas de aprendizaje, considero que la influencia en cuestión no es un mero resultado técnico, sino algo determinado por la forma en que las evaluaciones interactúan con los procesos de toma de decisiones de las organizaciones. Cuatro factores recurrentes ayudan a explicar por qué incluso evaluaciones bien realizadas suelen tener dificultades para ser influyentes.

Desajuste entre el calendario de las evaluaciones y los ciclos de decisión

Uno de los obstáculos más habituales es el momento en que se llevan a cabo las evaluaciones.

Los resultados suelen llegar tras la adopción de las decisiones principales. Cuando se presentan, lo más probable es que los presupuestos estén cerrados, los diseños de los programas esté aprobados o los compromisos de los donantes estén garantizados. Así, las evaluaciones se limitan a fundamentar decisiones que no se pueden reconsiderar.

Este desajuste no se debe únicamente a los evaluadores. En numerosas organizaciones, el calendario de las evaluaciones suele obedecer a obligaciones contractuales o de presentación de informes, y no guarda relación con el proceso de adopción de decisiones. Como consecuencia, las evaluaciones se suelen llevar cabo para satisfacer requisitos de rendición de cuentas, en lugar de para fundamentar decisiones aún abiertas.

Cuando las evaluaciones se realizan una vez que no hay margen para reconsiderar las decisiones, incluso aquellas con resultados bien fundamentados tienen dificultades para tener una cierta relevancia. La influencia depende de la cercanía temporal a los momentos clave del proceso de toma de decisiones, no del mero cumplimiento de los calendarios previstos.

Evaluaciones diseñadas para responder preguntas, no para orientar decisiones

El segundo factor está relacionado con cómo se plantean las evaluaciones en la fase de diseño.

Los diseños de las evaluaciones suelen comenzar con preguntas relacionadas con el aprendizaje (¿qué queremos saber sobre la relevancia, la eficacia o los efectos?). Aunque estas preguntas son importantes, se suelen formular sin considerar claramente cómo se utilizarán los resultados en la práctica.

Algunas preguntas fundamentales serían:

- ¿Quiénes son los usuarios principales de la evaluación?

- ¿Qué decisiones se espera que fundamente?

- ¿Cuándo se adoptarán esas decisiones?

Cuando estas preguntas no se plantean de forma explícita, las evaluaciones pueden generar conocimientos analíticamente sólidos, pero difícilmente aplicables en la práctica. Los resultados pueden ser interesantes, e incluso convincentes. Pero pueden carecer de la capacidad para respaldar decisiones concretas, como adaptar o no una intervención, ampliar un enfoque o suspender una estrategia.

En estas situaciones, los resultados de la evaluación deben competir con otros factores que impulsan la toma de decisiones, como las consideraciones políticas, las restricciones presupuestarias y las prioridades organizativas. Sin una vinculación clara con necesidades de decisión específicas, incluso las evidencias más sólidas pueden tener dificultades para tener mayor relevancia.

Cuando la influencia se considera algo puntual, no un proceso

La influencia de una evaluación se suele considerar como algo que ocurre al final de su ciclo, normalmente por medio de talleres de difusión, presentaciones o informes finales.

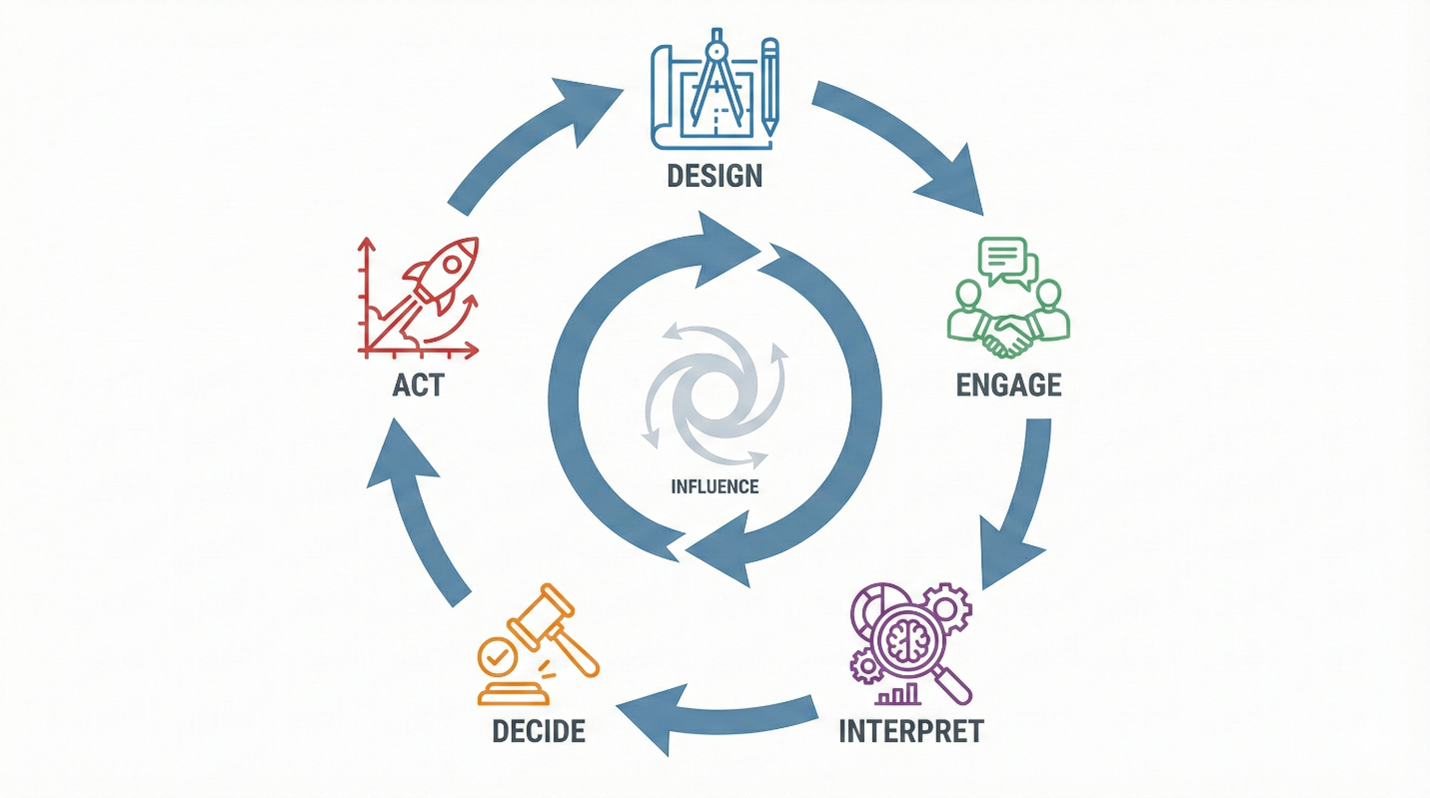

Una vez que los resultados se comparten formalmente, se presupone que los responsables de la toma de decisiones los asimilarán y actuarán en consecuencia. En la práctica, la influencia no suele funcionar así. Lo habitual es que se desarrolle gradualmente a través de un proceso continuo de participación, interpretación y diálogo.

Cuando los resultados de una evaluación se presentan como productos fijos —y no como parte de un proceso más amplio de reflexión y debate— se reconocen con mayor facilidad, pero también se ignoran fácilmente. Por el contrario, las evaluaciones que influyen en las decisiones suelen implicar a las partes interesadas a lo largo de todo el proceso, creando un entendimiento común y generando un sentido de apropiación de los resultados mucho antes de finalizar las recomendaciones.

Esta perspectiva concuerda con la evaluación centrada en la utilización, que pone de relieve la participación y la interpretación iterativa como condiciones principales para su uso (Patton, 2008).

Incentivos organizativos que desalientan el uso de las evaluaciones

Los resultados de las evaluaciones se interpretan dentro de sistemas organizativos que determinan cómo se reciben las evidencias y cómo se actúa en consecuencia

En muchos contextos, los resultados pueden conllevar riesgos. Pueden ser peores de lo previsto, cuestionar estrategias establecidas o complicar narrativas ya existentes sobre el éxito de los programas. Cuando los sistemas de rendición de cuentas priorizan el cumplimiento, la presentación de informes a los responsables o la reputación, los responsables de la toma de decisiones pueden tener pocos incentivos para participar plenamente con evidencias que generen incertidumbre o incomodidad.

En estos entornos, el uso limitado de las evaluaciones no es un mero problema técnico. Refleja dinámicas organizativas y políticas más amplias que restringen la forma en que examinan las evidencias y se actúa en consecuencia. Dichas dinámicas suelen ser visibles para los evaluadores, pero difíciles de abordar directamente, especialmente cuando los mandatos de las evaluaciones hacen hincapié en la generación de informes, y no tanto en el aprendizaje.

Qué significa esto para la práctica de la evaluación

Estos patrones sugieren que la inversión continua en rigor técnico no es suficiente para reforzar la influencia de la evaluación.

Es más probable que las evaluaciones fundamenten decisiones cuando se presta atención no solo a su calidad metodológica, sino también a cómo se posicionan en los procesos de decisión.

En la práctica, esto significa tener más en cuenta:

● la alineación entre el los calendarios de las evaluaciones y los ciclos de decisión,

● una formulación clara de las decisiones que la evaluación pretende fundamentar,

● la facilitación e interpretación continuas durante el proceso de evaluación, y

● los incentivos organizativos que determinan cómo se reciben y utilizan las evidencias.

Los evaluadores deben ir más allá de la producción de evidencias y contribuir a crear las condiciones adecuadas para su uso. Para los evaluadores, esto puede implicar ir más allá del papel de productores de evidencias, y determinar activamente las condiciones que permitan que dichas evidencias fundamenten decisiones reales.

Referencias

Munyayi, A. (2025). From shelf-ware to action: Unpacking the utilization of project evaluation reports in Zimbabwe’s development sector. International Journal of Research and Scientific Innovation. https://doi.org/10.51244/IJRSI.2025.12050096

Patton, M. Q. (2008). Utilization-focused evaluation (4th ed.). Sage Publications.

World Bank Independent Evaluation Group. (2014). Learning and results in World Bank operations: Toward a new learning strategy. World Bank.