Au cours des deux dernières décennies, le domaine de l'évaluation a considérablement renforcé sa qualité technique. Les normes méthodologiques se sont améliorées, les approches mixtes sont largement utilisées, et les exigences en matière de rigueur et de transparence ont augmenté.

Au cours des deux dernières décennies, le domaine de l'évaluation a considérablement renforcé sa qualité technique. Les normes méthodologiques se sont améliorées, les approches mixtes sont largement utilisées, et les exigences en matière de rigueur et de transparence ont augmenté.

Cependant, un défi persiste dans l'ensemble du domaine: même des évaluations techniquement solides, fondées sur des méthodes rigoureuses et une analyse approfondie, ont une influence limitée sur la prise de décision.

Dans les programmes de développement, humanitaires et environnementaux, les rapports d'évaluation sont produits, reconnus formellement, parfois même salués. Toutefois, leurs conclusions influencent rarement les choix stratégiques, l'allocation des ressources ou la révision des programmes. Comme le souligne Munyayi (2025), cette situation reflète un problème plus large: les rapports répondent aux exigences de redevabilité mais influencent peu les décisions.

Cette situation soulève une question centrale. Pourquoi des évaluations techniquement solides échouent-elles à orienter les décisions qu'elles sont censées éclairer?

En s'appuyant sur l'expérience en évaluation, suivi et apprentissage, on constate que l'influence de l'évaluation dépend de son interaction avec les processus décisionnels. Quatre facteurs expliquent cette situation.

Décalage entre le calendrier des évaluations et les cycles de décision

Le calendrier constitue un obstacle fréquent.

Les résultats arrivent souvent après que les décisions ont été prises. Les budgets sont approuvés, les programmes validés et les engagements pris. Les évaluations sont alors censées éclairer des décisions déjà arrêtées.

Ce décalage ne relève pas uniquement des évaluateurs. Les calendriers sont souvent définis en fonction des obligations contractuelles ou de reporting plutôt que du calendrier décisionnel. Les évaluations répondent ainsi davantage à des exigences de redevabilité qu'à des besoins décisionnels.

Lorsque les résultats arrivent trop tard, leur influence est limitée car celle-ci dépend du moment où les résultats sont disponibles.

Des évaluations conçues pour répondre à des questions plutôt que pour éclairer des décisions

Un second facteur concerne la conception.

Les évaluations sont en effet souvent définies autour de questions d'apprentissage portant sur la pertinence, l'efficacité ou l'impact, sans lien clair avec l'utilisation prévue des résultats.

Or, trois questions sont essentielles:

- Qui sont les utilisateurs principaux?

- Quelles décisions doivent être éclairées?

- Quand ces décisions seront-elles prises?

Sans ces éléments, les évaluations produisent des analyses solides mais difficiles à utiliser. Les conclusions peuvent être pertinentes, mais elles ne soutiennent pas des choix concrets tels qu'adapter, étendre ou arrêter une intervention.

Dans ce cas, les résultats entrent en concurrence avec d'autres facteurs comme les contraintes budgétaires, les priorités institutionnelles ou les considérations politiques. Sans lien avec des décisions précises, leur influence reste limitée.

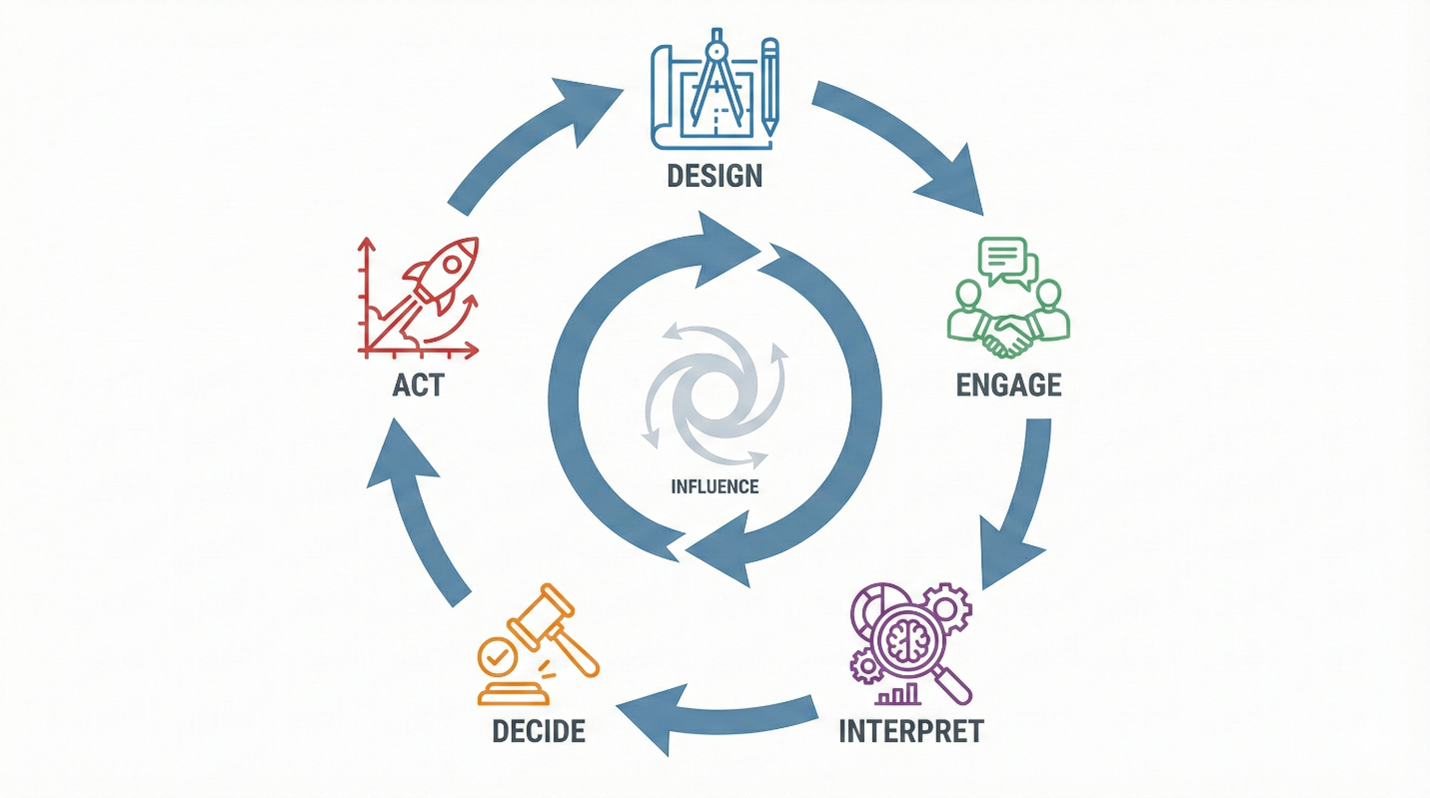

L'influence considérée comme un moment et non comme un processus

L'influence est souvent associée à la diffusion finale des résultats à travers des rapports ou des présentations.

L'hypothèse est que les décideurs utiliseront ces résultats après leur diffusion. En pratique, l'influence se construit progressivement par l'engagement, l'interprétation et le dialogue.

Lorsque les résultats sont présentés comme des produits finis, ils sont facilement reconnus, mais peuvent aussi être facilement ignorés. Les évaluations qui influencent les décisions impliquent les parties prenantes tout au long du processus et favorisent une appropriation progressive.

Cette approche correspond à l'évaluation centrée sur l'utilisation décrite par Patton (2008).

Des incitations organisationnelles faibles qui limitent l'utilisation des évaluations

Les résultats sont interprétés dans un cadre organisationnel.

Ils peuvent révéler des faiblesses, remettre en cause des stratégies ou compliquer les messages sur les performances. Dans des contextes où la conformité, le reporting ou la réputation sont prioritaires, les incitations à utiliser ces résultats sont faibles.

Dans ces conditions, la faible utilisation des évaluations ne relève pas uniquement de la technique. Elle dépend de dynamiques organisationnelles et politiques.

Implications pour la pratique de l'évaluation

Renforcer l'influence des évaluations ne dépend pas uniquement de la qualité technique.

Les évaluations influencent les décisions lorsque leur positionnement dans les processus décisionnels est pris en compte.

Cela implique:

- d'aligner le calendrier sur les décisions;

- de définir clairement les décisions à éclairer;

- de faciliter l'interprétation tout au long du processus;

- de prendre en compte les incitations organisationnelles.

Les évaluateurs doivent aller au-delà de la production de preuves et contribuer à créer les conditions de leur utilisation.

Références

Munyayi, A. (2025). From shelf-ware to action: Unpacking the utilization of project evaluation reports in Zimbabwe’s development sector. International Journal of Research and Scientific Innovation. https://doi.org/10.51244/IJRSI.2025.12050096

Patton, M. Q. (2008). Utilization-focused evaluation (4th ed.). Sage Publications.

World Bank Independent Evaluation Group. (2014). Learning and results in World Bank operations: Toward a new learning strategy. World Bank.